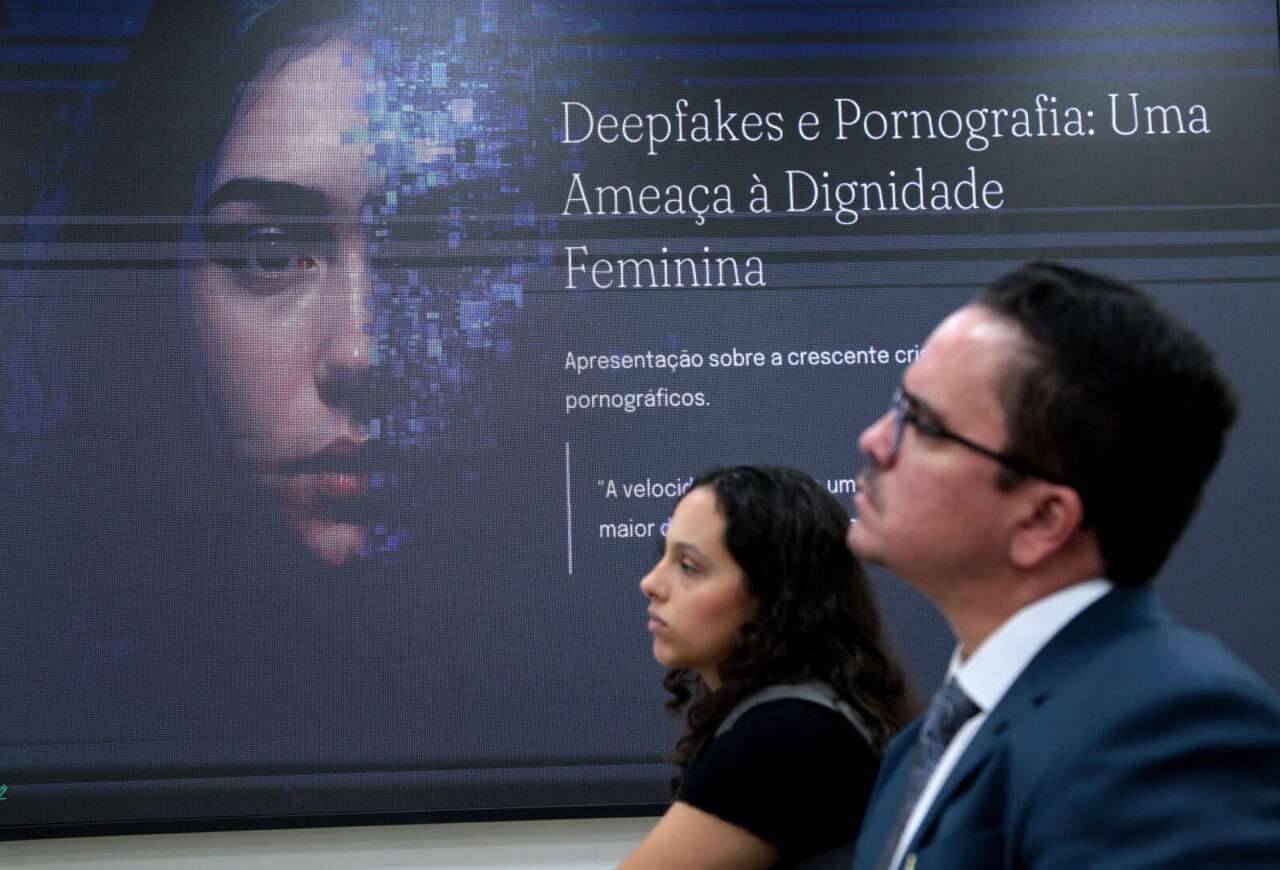

A Assembleia Legislativa de Mato Grosso (ALMT) se tornou palco de uma discussão de extrema importância sobre os impactos da tecnologia deepfake, com foco alarmante em sua utilização na produção de pornografia não consensual e na consequente violação da dignidade feminina. A Procuradoria Especial da Mulher da ALMT reuniu especialistas e autoridades nesta segunda-feira (28) para o debate “deepfake e a indústria pornográfica – a violação da dignidade feminina em segundos”. A iniciativa partiu de professores e estudantes de direito do Centro Universitário de Várzea Grande (Univag), demonstrando a preocupação da nova geração de juristas com essa crescente ameaça digital.

O cerne da discussão girou em torno da facilidade com que a inteligência artificial pode ser empregada para criar vídeos, imagens e áudios manipulados, imitando pessoas reais e fabricando conteúdo pornográfico sem o seu consentimento. A exploração atinge principalmente mulheres, mas também expõe crianças e adolescentes a riscos significativos. Estatísticas de 2019 já indicavam a predominância de conteúdo pornográfico (cerca de 96%) entre os deepfakes existentes, evidenciando a urgência em se debater e regulamentar essa tecnologia.

A estudante Raquel Cruz, do Univag, compartilhou a motivação do grupo em propor o debate, ressaltando a necessidade de trazer à luz um tema ainda pouco explorado, mas de grande impacto na vida das mulheres. A união dos conceitos de deepfake, pornografia e violência de gênero foi o ponto de partida para uma discussão que contou com o apoio fundamental do corpo docente da universidade.

Entre as propostas apresentadas durante o encontro, a conscientização nas escolas sobre os malefícios do uso indevido da inteligência artificial ganhou destaque. O professor do Univag, Bruno Rocha, enfatizou que a IA, assim como outras ferramentas tecnológicas, depende da ética de quem a utiliza. Ele defendeu a necessidade de educar a sociedade para um uso responsável e citou exemplos internacionais de responsabilização das plataformas digitais na disseminação de conteúdo prejudicial.

A delegada Mariell Antonini, da PJC, reforçou a urgência de um debate nacional para o fortalecimento da legislação penal, considerando que a pena atual para crimes dessa natureza pode ser considerada branda diante do potencial destrutivo da deepfake na vida das vítimas. Ela sugeriu a criminalização do armazenamento desse tipo de conteúdo, equiparando-o à legislação existente para a pornografia infantil.

A deputada federal Gisela Simona (União), participando remotamente, informou que o Congresso Nacional está atento à questão e discute projetos para aumentar as penalidades para quem produz e divulga conteúdo sexual falso criado com deepfake.

A deputada estadual Janaina Riva (MDB), procuradora especial da Mulher da ALMT, anunciou que buscará um diálogo direto com a bancada de Mato Grosso no Senado Federal para sensibilizá-los sobre a importância de avançar com projetos de lei que coíbam essa forma de violência digital contra a mulher.

A estudante do Univag, Yolanda Costa, expressou a relevância do debate na ALMT para que a sociedade compreenda a dimensão dos danos causados pela deepfake. A Polícia Civil orienta que a produção e divulgação de imagens manipuladas sem consentimento são crimes que podem ser denunciados.